Die Herausforderung

Haushaltsroboter haben das Potential, die menschliche Lebensqualität zu verbessern, indem sie Hausarbeiten erledigen oder auch persönliche Assistenz und Pflege übernehmen. Mögliche Nutzer_innen sind ältere Erwachsene, die zusätzliche Unterstützung benötigen, um weiter alleine zu wohnen; Kinder, die Bildungsunterstützung benötigen; Menschen mit bestimmten Krankheiten oder Behinderungen, die Unterstützung und Pflege benötigen; und Menschen, die allgemeine Unterstützung bei Hausarbeiten brauchen (z. B. Putzen, Kochen, Wäsche falten). Viele dieser Aufgaben fallen typischerweise Frauen zu, und zwar auf eine Art, die durch Klasse und wirtschaftlichen Status noch verstärkt wird. Es ist wichtig, sich die intersektionalen Aspekte des Roboterdesigns in unterschiedlichen Umgebungen zu überlegen.

Zudem ist es wichtig, sich zu überlegen, wie Roboter Vertrauen wecken, die funktionellen Bedürfnisse der Nutzer_innen erfüllen und eine Anpassung ermöglichen können, die zu den Werten der Menschen im Haushalt passt. Diese Werte können sich je nach Kultur und Art des Haushalts unterscheiden (z. B. Single, Familie, Wohngemeinschaft), ebenso wie je nach den einzelnen Personen in einem Haushalt. Sie sind formbar und können sich mit der Zeit verändern. Um diese Ziele zu erreichen, können Roboterdesigner:innen im Designprozess unterschiedliche Formen der intersektionalen Analyse einsetzen und bei der Gestaltung von Robotern mit potentiellen Endnutzer:innen in Haushalten zusammenarbeiten – von den ersten bis zu den letzten Schritten des Prozesses.

Haushaltsroboter müssen für unterschiedlichste Menschen, die in unterschiedlichen Haushaltsformen leben (Abb. 1) Barrierefreiheit, Würde, Vorlieben und Selbstwirksamkeit unterstützen. Darunter unter anderem:

- Alleinstehende Menschen, Familien, Wohngemeinschaften, Rehabilitierungszentren, Gemeinschaftshäuser

- Menschen mit Behinderungen

- Menschen mit unterschiedlichem Alter, Gewicht, und Größe

- Menschen im gesamten Spektrum von Gender, Ethnien, Hautfarben, Sprachen und Kulturen

- Untermieter und Gäste

- Nicht-menschliche Mitbewohner_innen, insbesondere Haustiere und Pflanzen.

Roboter müssen für unterschiedliche Gebäudearten ausgelegt sein, etwa:

- Einfamilienhäuser

- Reihenhäuser

- Wohnungen.

Roboter müssen auch für unterschiedlich konfigurierte Wohnräume ausgelegt werden, etwa:

- Smart Homes

- Infrastruktur (Strom, Steckdosen, Internet).

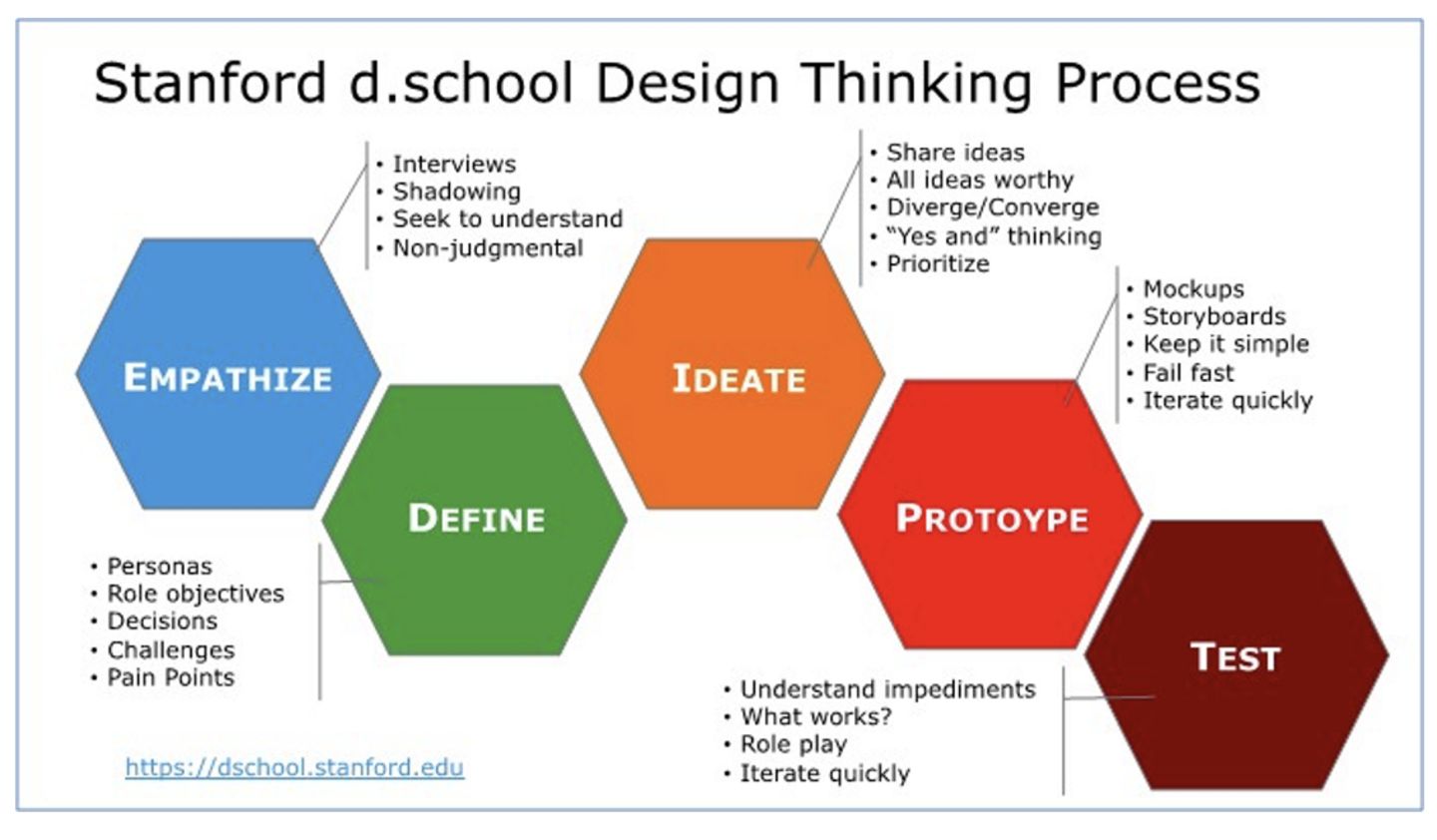

Ein repetitiver Designprozess kann es den Designer_innen ermöglichen, ihre Annahmen zu überprüfen und die Auswirkungen des Robotereinsatzes besser zu verstehen (im Hinblick auf Gender, vgl. Analyse des sozialen Geschlechts). Nutzer_innen in den Designprozess einzubeziehen, erhöht die Wahrscheinlichkeit von Lösungen, die ihre unterschiedlichen Bedürfnisse und Vorlieben widerspiegeln.

Abb. 1. Der Design Thinking Process gemeinsam mit einer intersektionalen Analyse kann eingesetzt werden, um ein inklusiveres Design von Haushaltsrobotern zu entwickeln. Mit freundlicher Erlaubnis der Stanford d.School.

Aktivitäten, Verhaltensweisen, Kommunikationsgewohnheiten und Datenverarbeitung des Roboters sollten auf Folgendes ausgerichtet sein:

- Werte der einzelnen Haushaltsmitglieder (z. B. häuslicher Bereich, Privatsphärebedürfnisse, Autonomie, Gleichheit, Reinlichkeitsstandards, und Selbstwirksamkeit)

- Haushaltsnormen (z. B. Verantwortlichkeiten und Machtbeziehungen).

Einsichten in die Art, wie Kultur- und Geschlechterunterschiede häusliche Aufgaben beeinflussen, sowie in die ihnen zugrundeliegenden Werte und Normen helfen beim Design von situationsgerechten Robotern.

Methode: Mitgestaltung und partizipatorisches Design , öffnet eine externe URL in einem neuen Fenster

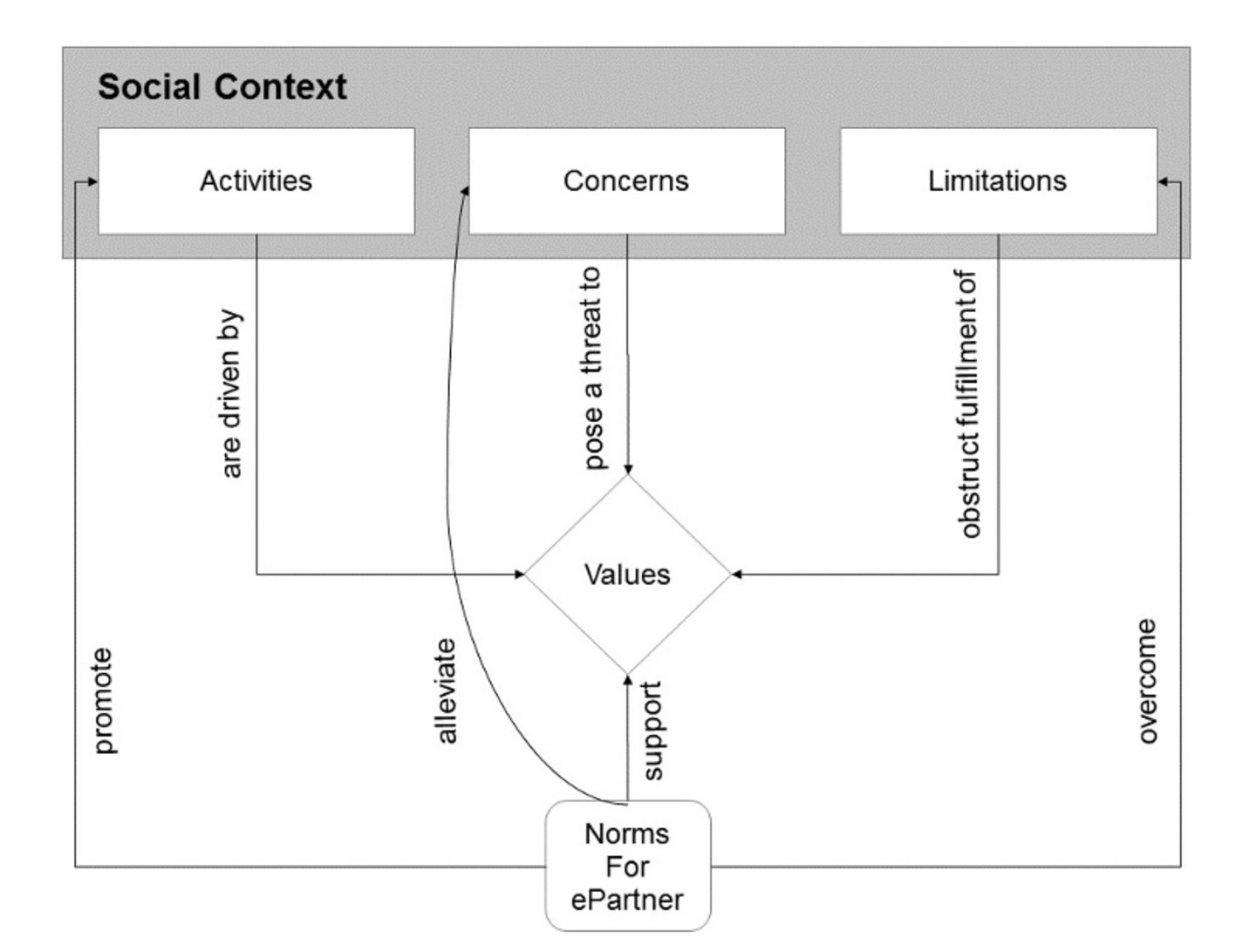

Ein entscheidender Schritt ist die Entwicklung eines Werte-und-Normen-Modells für die Informationsdatenbank des Roboters, damit er bei Hausarbeit als Partner fungieren kann (vgl. Abb. 2).

Abb. 2: Werte und Normen-Modell (Kayal et al., 2019).

Dieses Werte-und-Normen-Modell muss für die spezifischen Aufgaben des Roters jeweils instantiiert werden (z. B. Abstand halten und Daten zur Wahrnehmung von Schmutz verarbeiten). Der Roboter sollte auch fähig sein, die Norm und ihre Eigenschaften in Bezug auf die Normen unterschiedlichen Haushaltsmitgliedern zu erklären (z. B. Ursprung und Grund für die Norm) (Miller, 2019). Es ist zu beachten, dass die Normen Inklusivität fördern sollten (z. B. spezifische Hilfsbedürfnisse von Bewohner:innen mit Behinderungen, die eine größere Autonomie des Roboters erfordern können).

Weitere Informationen zu wertesensiblem Design, siehe Friedman et al. (2017); Methoden der Werteerhebung und Werterzählungs-Workshops, siehe Harbers et al. (2015); und Grounded Theory, siehe Kayal et al. (2019) und Cremers et al. (2014).

Methode: Mitgestaltung & Partizipatorische Forschung

Nutzer_innen müssen verstehen, wie Entscheidungen bezüglich bestimmter Werte die Leistung des Roboters beeinflussen können. Wenn der Haushalt sich etwa entscheidet, Daten local zu speichern, um die Privatsphäre zu schützen, könnte es sein, dass der Roboter langsamer lernt (Abb. 3).

Abb. 3: Haushaltsroboter und ihre Nutzer_innen müssen Normen etablieren und Vereinbarungen über Roboteraktivitäten treffen, die mit Wertkonflikten einhergehen. Bildnachweis: Pikbest.

Roboter müssen mit unterschiedlichen Menschen in verschiedenen häuslichen Umgebungen funktionieren. Gefälle zwischen Design und Einsatz können folgende Ursachen haben:

- Missverhältnis zwischen Trainingsszenarien und Einsatzumgebungen

- Dieses Missverhältnis kann sich in der visuellen Wahrnehmung des Roboters zeigen (Wang et al., 2019). Die visuelle Wahrnehmung eines Roboters muss trainiert werden, um Diversität zu erkennen, zum Beispiel für Übergabeaufgaben die zwischen Links- Rechts- oder Beidhändern (Kennedy et al., 2017).

- Dieses Missverhältnis kann sich in der Spracherkennung des Roboters zeigen. Designer können etwa eine reduzierte Sprachwahrnehmung für bestimmte Gruppen wie Kinder vorhersehen und multimodale Reparaturmechanismen in den Dialog einbauen, sodass der Roboter verstehen und das Gespräch weiterführen kann (Ligthart et al., 2020).

- Ein Missverhältnis zwischen Entwickler und Heimnutzer:innen hinsichtlich der Erwartungen an und Vorstellungen vom Roboter (Lee et al., 2014). So kann sich etwa die Vorstellung von Nutzer:innen und Robotiker:innen, was ein Roboter ist, insbesondere im Hinblick auf humanoide und soziale Roboter (Thellman et al., 2022; Gendering Social Robots). Verzerrte Wahrnehmungen können auf Seiten der Nutzer:innen (Tay et al., 2014; Perugia et al., 2022) oder der Robotiker:innen vorkommen (Robertson, 2010; Seaborn & Frank, 2022).

Diese Missverhältnisse können sich aus der Hintergrundinformation ergeben, die den Robotiker_innen während der Entwicklung von Systemen zur Verfügung stehen (Abb. 4). Darunter sind etwa Problemdefinition, Auswahl der Eigenschaften und Datenquellen für das Maschinenlernen, die in Trainingsszenarien verwendet werden, im Gegensatz zu den Einsatzumgebungen.

Abb. 4: Einsatzortabweichung in einem realen Haus (links) gegenüber einem Haus in einem robotischen Simulator (rechts). Bildnachweis: Selma Šabanović; Ruohan Zhang, BEHAVIOR-1K, entwickelt von Stanford Vision and Learning Lab, mit freundlicher Erlaubnis.

Die Einsatzortabweichungen zwischen Training- und Einsatz zu korrigieren, erfordert Diversität bei Trainingsaufgaben, Umgebungen, und Evaluierungsmetrik. Entwickler:innen können diese Diversität bei Demonstrationen, Gebrauchsanweisungen und Interaktionen berücksichtigen. Sie können zudem sicherstellen, dass Roboter die Nutzerbedürfnisse erfüllen, indem sie potentielle Endverbraucher_innen in den Designprozess einbeziehen (Olivier et al., 2022; Barnes et al., 2017; Lee et al., 2017).

Neue Methoden des Maschinenlernens wie Multi-Task-Learning und Adversiarial Training können ebenfalls eingesetzt werden, um den Modell-Bias zu verringern (Benton et al., 2017; Zhang et al., 2018). Diese Methoden haben das Potential, die Leistung für verschiedene Nutzer:innen in unterschiedlichen Umgebungen zu verbessern, werden jedoch bisher in der Robotik noch nicht breit angewandt. Zudem ist es wichtig, die Datenquellen, Methoden der Eigenschaftsextraktion und die entsprechenden Maschinenlernmodelle kritisch zu betrachten, um möglichen Bias-Quellen zu identifizieren und zu beseitigen. Einschränkungen sollten in Roboterdesigns und -anwendung klar benannt warden.

Die Einführung von Robotern in Haushalten kann die soziale Dynamik zwischen unterschiedlichen Menschen absichtlich oder ungewollt beeinflussen.

Häusliche Machtdynamik: Roboter greifen möglicherweise in die Interaktionen des Haushalts ein. Ein Robotermikrofon, dass sich einer Person zuwendet, die nichts gesagt hat, könnte eine gleichberechtigtere Gesprächsbeteiligung anregen (Tennent et al., 2019). Ein Roboter, der auf negative oder wütende Interaktionen im Haushalt mit Zusammenzucken oder Zurückschrecken reagiert, kann Haushaltsmitglieder dazu bewegen, über ihre Interaktionen nachzudenken und sie möglicherweise zu verbessern (Rifinski et al., 2021). Es ist daher wichtig, zu bedenken, wie der Roboter sich direkt oder indirekt auf die Machtdynamik im Haushalt auswirken kann. Endnutzer:innen einzubeziehen und die Leistung des Roboters in realen Haushaltssituationen anzupassen erlaubt ein Gleichgewicht zwischen Designvorschrift und Nutzerkontrolle in Roboterreaktionen in derartigen Interaktionen.

Körperliche Misshandlung: Sollten Roboter dafür designt werden, bei häuslicher Gewalt zu intervenieren? Erste Forschungen zeigen, dass Kinder missbräuchliches Verhalten eher Robotern als Erwachsenen melden (Bethel et al., 2016). Wie sollte der Roboter auf Gefahrensituationen reagieren? Sollte das Design von Robotern Berichtsfunktionen einschließen? Und an wen würden sie berichten? Müssen Nutzer:innen für diese Funktionen ihr Einverständnis geben oder sie deaktivieren? Wer im Haushalt würde das entscheiden – insbesondere in Fällen, in denen sich die Haushaltsmitglieder nicht einig sind? Nutzersensible Arbeit ist nötig, um diese offenen Fragen zu beantworten.

Überwindung von Stereotypen: Roboter, die in Haushalten eingesetzt werden, haben möglicherweise das Potential, die Geschlechtsspezifik von Hausarbeit in Frage zu stellen. Der Roomba zum Beispiel hat Teenager und Männer dazu angeregt, mehr staubzusaugen (Forlizzi, 2007). Roboter könnten Haushaltsmitglieder auch an ihre Pflichten erinnern und so diese emotionale Arbeit den Frauen abnehmen (Dobrosovestnova et al., 2021).

Breitere Machtdynamik: Solange Roboter nicht völlig autonom sind, können sie teilweise von Heimarbieter_innen fernbedient werden – die Gig Economy könnte sich in nächster Zukunft von MTurk weg in die Robotik bewegen (z. B. Mandlekar et al., 2018). IN manchen Fällen kann das positive Ergebnisse zeitigen, wie das DAWN Avatar Robot Café, öffnet eine externe URL in einem neuen Fenster in Tokio zeigt. Die DAWN-Roboter werden hauptsächlich von Menschen mit Behinderungen fernbedient und beziehen so Menschen in breitere soziale Netzwerke ein. Doch Gleichberechtigung ist nicht von Vorneherein gegeben. In der globalen Dienstleistungswirtschaft werden Pflegeroboter, die in Industrieländern eingesetzt werden, von Menschen Ländern mit niedrigen oder mittleren Einkommen bedient, was kritische Fragen bezüglich Arbeitsbedingungen, Herkunft der weltweiten Arbeit, und Arbeitsflüsse aufwirft (Guevarra, 2018). Roboter müssen möglicherweise bestehende Normen in ihren Einsatzumgebungen in Frage stellen. Normenkritische Innovation hinterfragt Machtverhältnisse, die unterschiedliche Formen von Diskriminierung aufrechterhalten können.

Schlussfolgerungen

Haushaltsroboter haben das Potential, die menschliche Lebensqualität enorm zu verbessern, sowohl indem sie Aufgaben und Haushaltsführung erledigen und persönliche Assistenz und Pflege übernehmen. Es ist wichtig, die intersektionalen Aspekte des Roboterdesigns in den Mittelpunkt zu stellen, indem das Design solcher Roboter von Robotiker:innen und Nutzer:innen gemeinsam erfolgt. Zur Sicherstellung von Fairness und Leistungsqualität müssen Entwickler:innen sich damit beschäftigen, wie Roboter Vertrauen wecken, die funktionalen Bedürfnisse unterschiedlicher Nutzer:innen erfüllen und Anpassungsmöglichkeiten an die unterschiedlichen Werte in einem Haushalt bieten können. Es ist ebenso wichtig, sich zu überlegen, wie Haushaltsprozesse verbessert werden können und Roboter nicht nur als Pflaster für ein System zu verwenden, das verbesserte Prozesse braucht. Haushaltsroboter der Zukunft könnten zum Beispiel auf die sozialen Rollen von Haushaltsmitglieder und ihre Interaktionen reagieren, auch auf negative, und darauf ethisch und werteorientiert eingehen.

Nächste Schritte

- Dieses Fallbeispiel beschäftigt sich mit Robotern im häuslichen Bereich. Es wird auch nötig sein, sich mit Interaktionen mit Systemen außerhalb des Haushalts zu beschäftigen, z. B. Lieferungen, Instandhaltung und Reparatur der Roboter, Recycling, soziale Einrichtungen und mögliche Fernbedienung des Roboters.

- Haushaltsroboter können breitere gesellschaftliche Auswirkungen haben, etwa menschliches Reinigungspersonal verdrängen. Gemeinden und nationale Regierungen sollten sich mit den breiteren Konsequenzen der Automation auseinandersetzen und Programme entwickeln, um Arbeitnehmer_innen im Hinblick auf den künftigen Bedarf umzuschulen.

Barnes, J., FakhrHosseini, M., Jeon, M., Park, C.-H., & Howard, A. (2017). The influence of robot design on acceptance of social robots. 2017 14th International Conference on Ubiquitous Robots and Ambient Intelligence (URAI), 51–55. doi.org/10.1109/URAI.2017.7992883

Benton, A., Mitchell, M., & Hovy, D. (2017). Multi-task learning for mental health using social media text (arXiv:1712.03538). arXiv. doi.org/10.48550/arXiv.1712.03538

Bethel, C. L., Henkel, Z., Stives, K., May, D. C., Eakin, D. K., Pilkinton, M., Jones, A., & Stubbs-Richardson, M. (2016). Using robots to interview children about bullying: Lessons learned from an exploratory study. 2016 25th IEEE International Symposium on Robot and Human Interactive Communication (RO-MAN), 712–717. doi.org/10.1109/ROMAN.2016.7745197

Cremers, A. H. M., Jansen, Y. J. F. M., Neerincx, M. A., Schouten, D., & Kayal, A. (2014). Inclusive design and anthropological methods to create technological support for societal inclusion. In C. Stephanidis & M. Antona (Eds.), Universal Access in Human-Computer Interaction. Design and Development Methods for Universal Access (pp. 31–42). Springer International Publishing. doi.org/10.1007/978-3-319-07437-5_4

Dobrosovestnova, A., Hannibal, G., & Reinboth, T. (2022). Service robots for affective labor: A sociology of labor perspective. AI & SOCIETY, 37(2), 487–499. doi.org/10.1007/s00146-021-01208-x

Forlizzi, J. (2007). How robotic products become social products: An ethnographic study of cleaning in the home. 2007 2nd ACM/IEEE International Conference on Human-Robot Interaction (HRI), 129–136. doi.org/10.1145/1228716.1228734

Friedman, B., Hendry, D. G., & Borning, A. (2017). A Survey of value sensitive design methods. Foundations and Trends® in Human–Computer Interaction, 11(2), 63–125. doi.org/10.1561/1100000015

Guevarra, A. R. (2018). Mediations of care: Brokering labour in the age of robotics. Pacific Affairs, 91(4), 739–758. doi.org/10.5509/2018914739

Harbers, M., Detweiler, C., & Neerincx, M. A. (2015). Embedding stakeholder values in the requirements engineering process. In S. A. Fricker & K. Schneider (Eds.), Requirements Engineering: Foundation for Software Quality (pp. 318–332). Springer International Publishing. doi.org/10.1007/978-3-319-16101-3_23

Kayal, A., Brinkman, W.-P., Neerincx, M. A., & van Riemsdijk, M. B. (2019). A user-centred social commitment model for location sharing applications in the family life domain. International Journal of Agent-Oriented Software Engineering, 7(1), 1–36.

Kennedy, J., Lemaignan, S., Montassier, C., Lavalade, P., Irfan, B., Papadopoulos, F., Senft, E., & Belpaeme, T. (2017). Child speech recognition in human-robot interaction: Evaluations and recommendations. Proceedings of the 2017 ACM/IEEE International Conference on Human-Robot Interaction, 82–90. doi.org/10.1145/2909824.3020229

Lee, H. R., Šabanovic, S., & Stolterman, E. (2014). Stay on the boundary: Artifact analysis exploring researcher and user framing of robot design. Proceedings of the SIGCHI Conference on Human Factors in Computing Systems, 1471–1474. doi.org/10.1145/2556288.2557395

Lee, H. R., Šabanović, S., Chang, W.-L., Nagata, S., Piatt, J., Bennett, C., & Hakken, D. (2017). Steps Toward Participatory Design of Social Robots: Mutual Learning with Older Adults with Depression. Proceedings of the 2017 ACM/IEEE International Conference on Human-Robot Interaction, 244–253. doi.org/10.1145/2909824.3020237

Ligthart, M. E. U., Neerincx, M. A., & Hindriks, K. V. (2020). Design patterns for an interactive storytelling robot to support children’s engagement and agency. Proceedings of the 2020 ACM/IEEE International Conference on Human-Robot Interaction, 409–418. doi.org/10.1145/3319502.3374826

Mandlekar, A., Zhu, Y., Garg, A., Booher, J., Spero, M., Tung, A., Gao, J., Emmons, J., Gupta, A., Orbay, E., Savarese, S., & Fei-Fei, L. (2018). ROBOTURK: A crowdsourcing platform for robotic skill learning through imitation. Proceedings of the 2nd Conference on Robot Learning, 879–893. proceedings.mlr.press/v87/mandlekar18a.html

Miller, T. (2019). Explanation in artificial intelligence: Insights from the social sciences. Artificial Intelligence, 267, 1–38. doi.org/10.1016/j.artint.2018.07.007

Mioch, T., Peeters, M. M. M., & Neerincx, M. A. (2018). Improving adaptive human-robot cooperation through work agreements. 2018 27th IEEE International Symposium on Robot and Human Interactive Communication (RO-MAN), 1105–1110. doi.org/10.1109/ROMAN.2018.8525776

Olivier, M., Rey, S., Voilmy, D., Ganascia, J.-G., & Lan Hing Ting, K. (2022). Combining cultural probes and interviews with caregivers to co-design a social mobile robotic solution. IRBM. doi.org/10.1016/j.irbm.2022.06.004

Perugia, G., Guidi, S., Bicchi, M., & Parlangeli, O. (2022). The shape of our bias: Perceived age and gender in the humanoid robots of the ABOT database. Proceedings of the 2022 ACM/IEEE International Conference on Human-Robot Interaction, 110–119. dl.acm.org/doi/10.5555/3523760.3523779

Rifinski, D., Erel, H., Feiner, A., Hoffman, G., & Zuckerman, O. (2021). Human-human-robot interaction: Robotic object’s responsive gestures improve interpersonal evaluation in human interaction. Human–Computer Interaction, 36(4), 333–359. doi.org/10.1080/07370024.2020.1719839

Robertson, J. (2010). Gendering humanoid robots: Robo-sexism in Japan. Body & Society, 16(2), 1–36. doi.org/10.1177/1357034X10364767

Seaborn, K., & Frank, A. (2022). What pronouns for Pepper? A critical review of gender/ing in research. Proceedings of the 2022 CHI Conference on Human Factors in Computing Systems, 1–15. doi.org/10.1145/3491102.3501996

Singh, M. P. (1999). An ontology for commitments in multiagent systems. Artificial Intelligence and Law, 7(1), 97–113. doi.org/10.1023/A:1008319631231

Tay, B., Jung, Y., & Park, T. (2014). When stereotypes meet robots: The double-edge sword of robot gender and personality in human–robot interaction. Computers in Human Behavior, 38, 75–84. doi.org/10.1016/j.chb.2014.05.014

Tennent, H., Shen, S., & Jung, M. (2019). Micbot: A peripheral robotic object to shape conversational dynamics and team performance. 2019 14th ACM/IEEE International Conference on Human-Robot Interaction (HRI), 133–142. doi.org/10.1109/HRI.2019.8673013

Thellman, S., de Graaf, M., & Ziemke, T. (2022). Mental state attribution to robots: A systematic review of conceptions, methods, and findings. ACM Transactions on Human-Robot Interaction (THRI), 11(4), 1-51. doi.org/10.1145/3526112

Wang, T., Zhao, J., Yatskar, M., Chang, K.-W., & Ordonez, V. (2019). Balanced datasets are not enough: Estimating and mitigating gender bias in deep image representations. 5310–5319. openaccess.thecvf.com/content_ICCV_2019/html/Wang_Balanced_Datasets_Are_Not_Enough_Estimating_and_Mitigating_Gender_Bias_ICCV_2019_paper.html

Zhang, B. H., Lemoine, B., & Mitchell, M. (2018). Mitigating unwanted biases with adversarial learning. Proceedings of the 2018 AAAI/ACM Conference on AI, Ethics, and Society, 335–340. doi.org/10.1145/3278721.3278779