Unsere Welt dreidimensional am Computer darzustellen ist heute nichts Ungewöhnliches mehr. Mit 3D-Scannern kann man Gesichter, Gebäude oder ganze Landschaften abtasten und aus den Daten ein 3D-Modell generieren. Allerdings ist das meist sehr aufwändig. In dem von der TU Wien geleiteten Forschungsprojekt „Harvest4D, öffnet eine externe URL in einem neuen Fenster“ (geleitet von Prof. Michael Wimmer vom Institut für Computergraphik und Algorithmen der TU Wien) werden daher Algorithmen entwickelt, mit denen man aus bestehenden Bilddaten, die gar nicht unbedingt für diesen Zweck gesammelt wurden, diese dreidimensionale Welten viel einfacher erstellen kann. Sogar ihre zeitliche Entwicklung lässt sich so am Computer studieren. Solche Softwarelösungen lassen sich in ganz unterschiedlichen Bereichen einsetzen – von der Archäologie bis zur Hochwasserforschung.

3D-Welten berechnen, aus 2D-Fotos

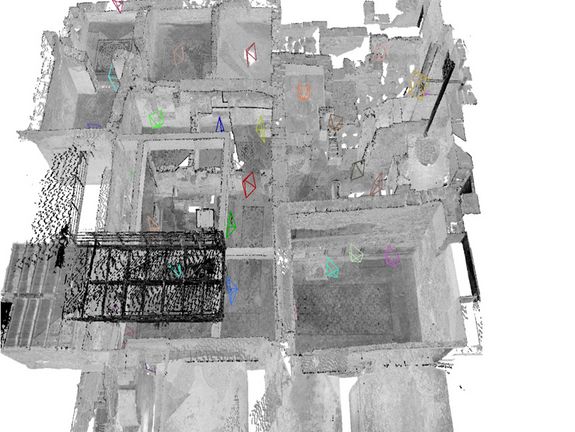

„Bisher erstellte man 3D-Abbilder der Wirklichkeit meist auf recht komplizierte Weise, zum Beispiel mit Laser-Scannern“, erklärt Michael Wimmer. „Fachleute müssen eine Scan-Kampagne sorgfältig planen, hochauflösende Bilder machen und die Daten am Ende noch mühsam nachbearbeiten.“ Nur so kann man aus einer dreidimensionalen Punktwolke schöne, glatte Flächen und klare Formen erzeugen.

„Uns schwebt in diesem Bereich ein radikaler Paradigmenwechsel vor“, sagt Michael Wimmer. „Uns steht heute so umfangreiches Datenmaterial zur Verfügung wie noch nie zuvor – mit den passenden Algorithmen kann man diese Bilddaten nutzen.“ Geräte, die hochqualitative Bilder aufnehmen können, werden immer alltäglicher. Schon heute hat fast jeder ein Fotohandy mit dabei. Quadcopter mit Webcam waren vor einigen Jahren noch teures High-Tech-Equipment, heute sind sie eine erschwingliche Spielerei.

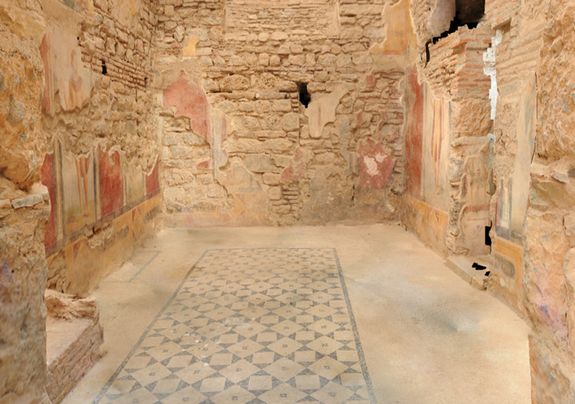

Aus großen Sammlungen von Bilddaten lassen sich mit den passenden Rechenmethoden dreidimensionale Welten generieren. „Am Computer werden die Bilder dann nicht einfach nur zusammengestückelt, sondern wir errechnen aus ihnen ein vollständiges 3D-Modell“, sagt Reinhold Preiner, Projektmitarbeiter. Man kann sich also am Bildschirm frei um ein Objekt herumbewegen und kann es aus beliebigen Blickwinkeln ansehen – auch aus solchen, die auf den Bildern gar nicht vorkamen. Ausgrabungen können virtuell studiert und analysiert werden, man kann sie sogar für den User zuhause virtuell in hoher Qualität zugänglich machen.

Fehlertolerante Bildanalyse

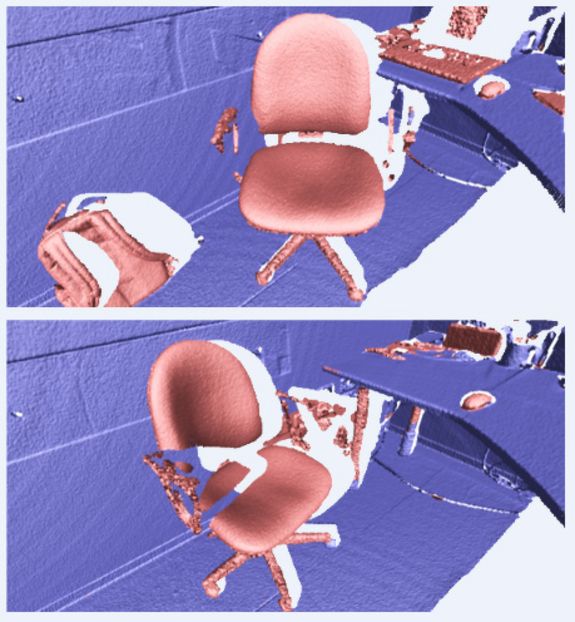

Um das zu erreichen muss man Programme entwickeln, die Fehler tolerieren - denn die Daten sind nie perfekt. Bilder sind manchmal unscharf, sie zeigen Objekte bei sehr unterschiedlichen Lichtverhältnissen, und Scans können Artefakte enthalten, die die Rekonstruktion stören. Trotzdem gelingt es mit den Rechenmethoden, die nun im Forschungsprojekt „Harvest4D“ entwickelt wurden, solche Bilddaten automatisiert aufzubereiten. So wurden etwa archäologische Ausgrabungen dreidimensional visualisiert – die Ausgangsdaten waren ganz gewöhnliche Fotos, zusätzlich wurde in diesem Fall die grobe Struktur mit einem Laserscan gemessen. Die Detailtiefe der Visualisierung muss nicht überall gleich sein: Bei gewöhnlichem Mauerwerk genügt eine eher grobe Darstellung, wertvolle Fresken an der Wand möchte man sich aber vielleicht genauer ansehen. Hochauflösende Bilder der Fresken können daher zusätzlich in das 3D-Modell eingebaut werden.

Wenn man die Daten nicht für wissenschaftliche Zwecke braucht, dann muss man nicht unbedingt die maximale Detailtiefe nutzen. Gibt man sich mit etwas weniger Genauigkeit zufrieden, dann können auch Endgeräte wie Laptops oder Smartphones die 3D-Modelle flüssig darstellen. Am Computergraphik-Institut an der TU Wien wurde eigens dafür der „potree viewer“ entwickelt. Er verwendet spezielle Techniken zu Darstellung großer Punktewolken, die nicht in den Speicher leistungsschwacher Endgeräte passen.

Veränderungen in 4D

Wenn man weiß, zu welchem Zeitpunkt die Bilder aufgenommen wurden, kann man den drei Raumdimensionen noch eine zeitliche Dimension hinzufügen und untersuchen, wie sich die beobachtete 3D-Welt verändert. Auch das ist für den Computer eine schwierige Aufgabe: Haben sich die abgebildeten Objekte tatsächlich verändert, oder sehen die Bilder nur unterschiedlich aus, weil sie bei unterschiedlichen Lichtverhältnissen, aus unterschiedlichen Winkeln oder mit unterschiedlichen Geräten aufgenommen wurden? Menschen fällt es normalerweise recht leicht, solche Fragen zu beantworten – diese Fähigkeit einem Computer beizubringen, ist eine große Herausforderung. Solche Algorithmen können sogar für die Hochwasserforschung interessant sein. „Anwendungsmöglichkeiten für unsere Algorithmen gibt es praktisch überall – und ständig kommen neue dazu“, sagt Stefan Ohrhallinger, Projektmitarbeiter.

Das FP7 EU Forschungsprojekt „Harvest4D“ ist ein Konsortium aus den folgenden europäischen wissenschaftlichen Partnern:

1. TU Wien, Austria - Institute of Computer Graphics and Algorithms - Scientific Leader: Michael Wimmer

2. University of Bonn , Germany - Computer Graphics Group - Scientific Leader: Reinhard Klein

3. Technical University Darmstadt – Darmstadt, Germany - Interactive Graphics Systems Group, Scientific Leader: Michael Goesele – Visual Inference Group, Scientific Leader: Stefan Roth

4. Telecom ParisTech – Paris, France - Computer Graphics Group - Scientific Leader: Tamy Boubekeur

5. Istituto Scienza e Tecnologie dell'Informazione (ISTI) -Consiglio Nazionale delle Ricerche – Pisa, Italy - Visual Computing Lab - Scientific Leader: Roberto Scopigno

6. Technical University Delft - Computer Graphics and Visualization Group - Scientific Leader: Elmar Eisemann

Mehr dazu: https://harvest4d.org/, öffnet eine externe URL in einem neuen Fenster

Bilderdownload, öffnet eine externe URL in einem neuen Fenster

Rückfragehinweis:

Prof. Michael Wimmer

Institut für Computergraphik und Algorithmen

Technische Universität Wien

Favoritenstraße 9-11, 1040 Wien

T: +43-1-58801-18687

wimmer@cg.tuwien.ac.at

Aussender:

Dr. Florian Aigner

Büro für Öffentlichkeitsarbeit

Technische Universität Wien

Operngasse 11, 1040 Wien

T: +43-1-58801-41027

florian.aigner@tuwien.ac.at